17 iPhone-Funktionen, die maschinelles Lernen und KI nutzen

In diesem Handbuch gehen wir auf mehrere vorhandene iOS-Funktionen ein, die künstliche Intelligenz (KI) und maschinelles Lernen (ML) verwenden, um Ihrem iPhone und iPad neue und leistungsstarke Funktionen bereitzustellen.

Apple Intelligence (Apples Bezeichnung für die hauseigene KI) wurde zusammen mit iOS 18 angekündigt, ist aber noch nicht erschienen. Es soll mehrere Funktionen bieten, wie das Korrekturlesen Ihrer Texte, das Ändern Ihrer Satzstruktur, das Zusammenfassen langer Texte, das Anzeigen der dringendsten E-Mails und Benachrichtigungen an oberster Stelle, das Umwandeln Ihrer Skizze in Bilder, das Entfernen nicht benötigter Objekte aus einem Fotohintergrund und vieles mehr.

Während Apple Intelligence die KI-Funktionen für iPhone-Benutzer sicherlich auf die nächste Stufe heben wird, sind mehrere bestehende Aspekte von iOS und iPadOS bereits stark von künstlicher Intelligenz und maschinellem Lernen abhängig. Im Folgenden gehen wir auf die wichtigsten ein.

Bevor Sie damit beginnen, müssen Sie wissen, dass KI und ML eng verwandt sind. Wenn Sie jedoch die Unterschiede zwischen ihnen verstehen möchten, bieten Google Cloud und Amazon AWS hervorragende Artikel, die Ihre Zeit wirklich wert sind.

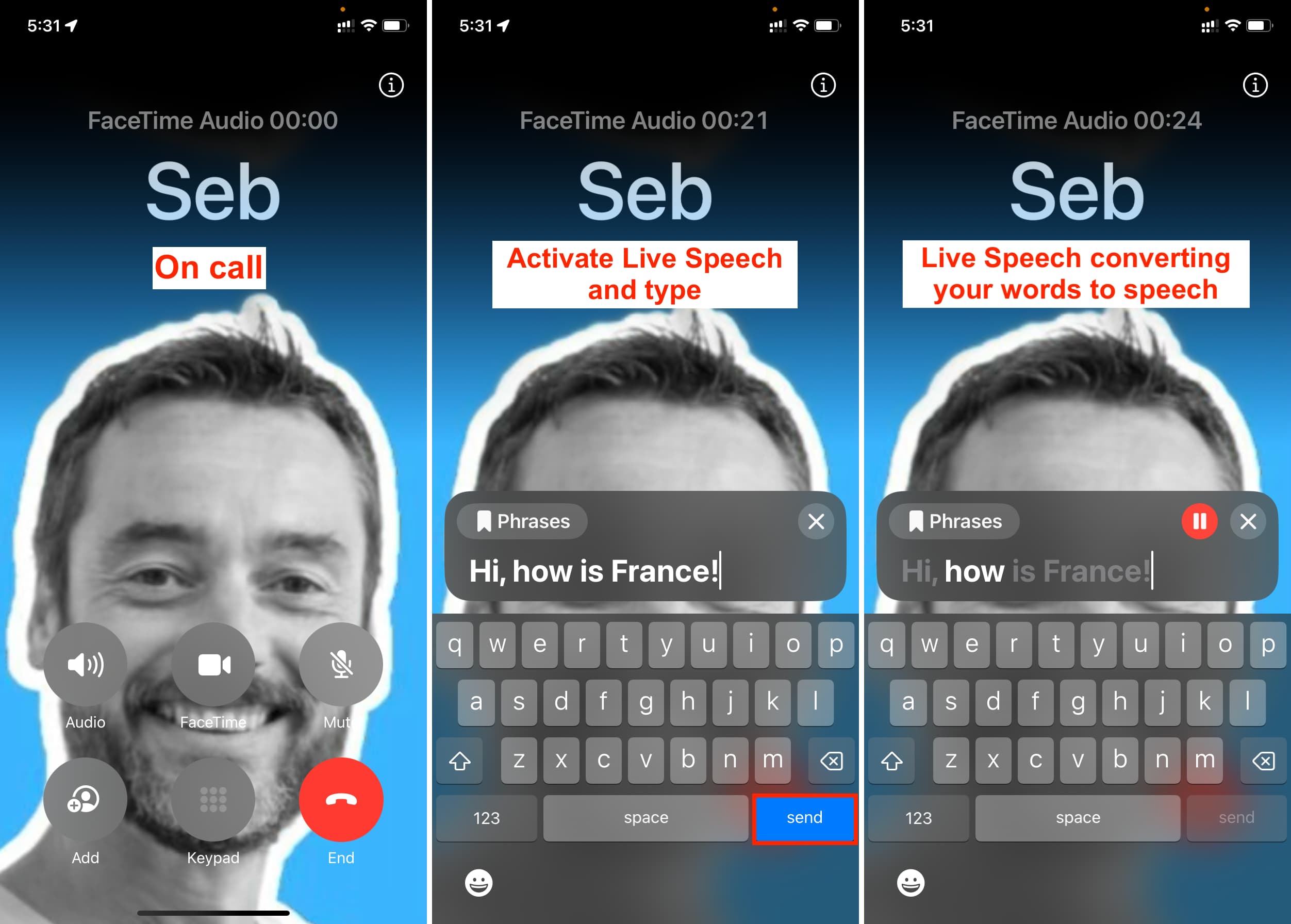

1. Erstellen Sie Ihre persönliche Stimme

Dank Apples maschinellem Lernen können Menschen, die Gefahr laufen, ihre Sprache zu verlieren, eine künstliche Stimme erzeugen, die wie sie klingt.

Diese synthetisierte Stimmnachbildung kann mit der Live Speech-Funktion bei FaceTime, Telefonanrufen, Apps und persönlicher Kommunikation verwendet werden. Der Benutzer kann einfach eintippen, was er sagen möchte, und sein iPhone spricht die geschriebenen Worte mit seiner Stimme aus!

2. Steuern Sie Ihr iPhone mit Ihren Augen

Sie können einen schnellen Einrichtungsprozess für Eye Tracking durchlaufen und dann kann Apples maschinelles Lernen auf dem Gerät Ihre Augenbewegungen erkennen, um Elemente hervorzuheben und durch bloßes Hinsehen ein Tippen auszuführen. Dies ist hilfreich für Personen, die den Touchscreen aufgrund einer körperlichen Behinderung nicht verwenden können.

![]()

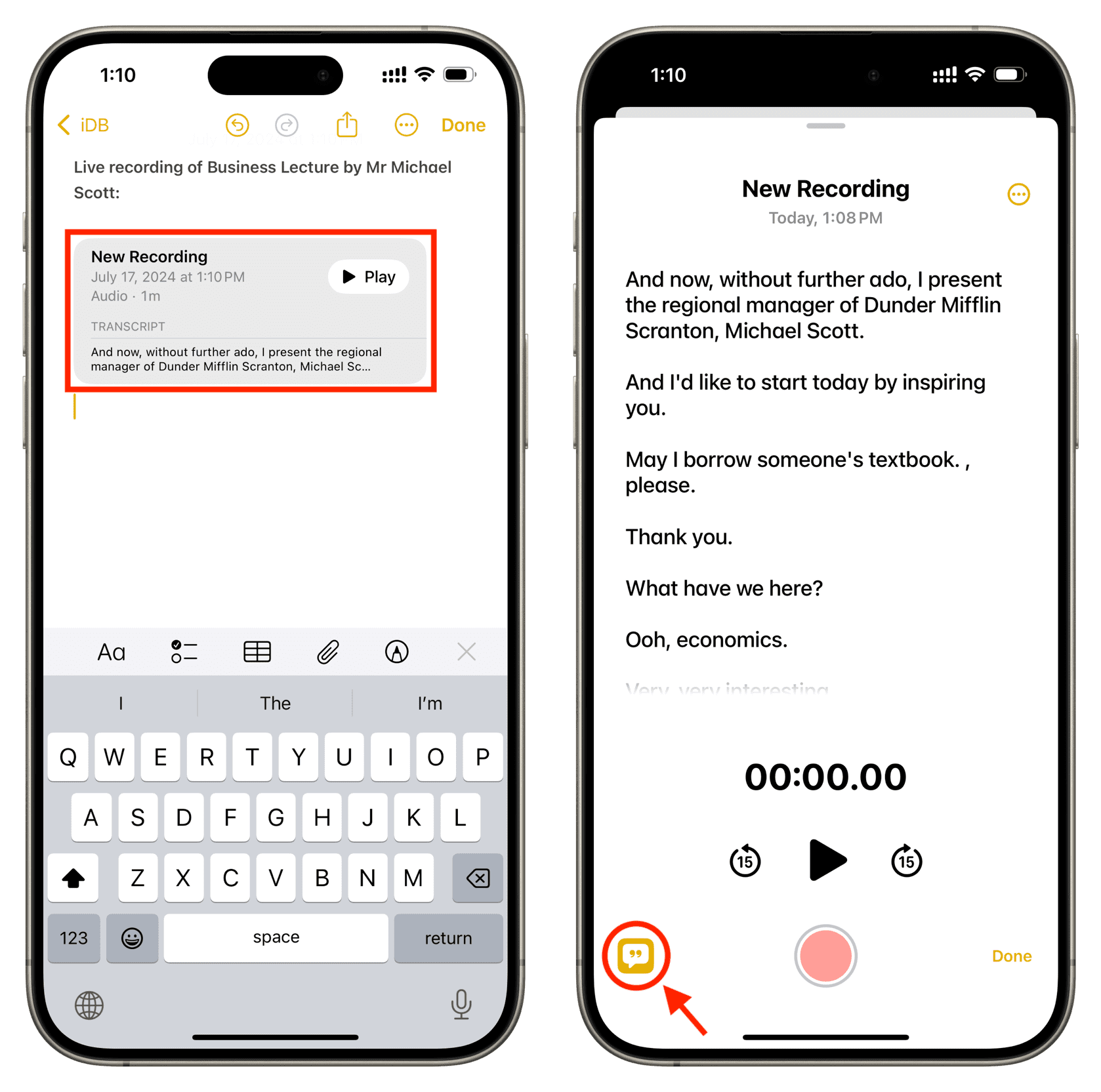

3. Live-Untertitel und Transkription auf dem Gerät

Ihr iPhone kann Audio verstehen und in Textform auf dem Bildschirm anzeigen. So kann beispielsweise eine gehörlose Person Live-Untertitel in FaceTime-Anrufen oder beim Ansehen von Videos verwenden. Dies ist auch beim Transkribieren von Sprachaufnahmen in Apps für Sprachmemos und Notizen hilfreich.

Um größtmögliche Privatsphäre zu gewährleisten, erfolgt die gesamte Verarbeitung lokal auf dem Gerät ohne Internetverbindung.

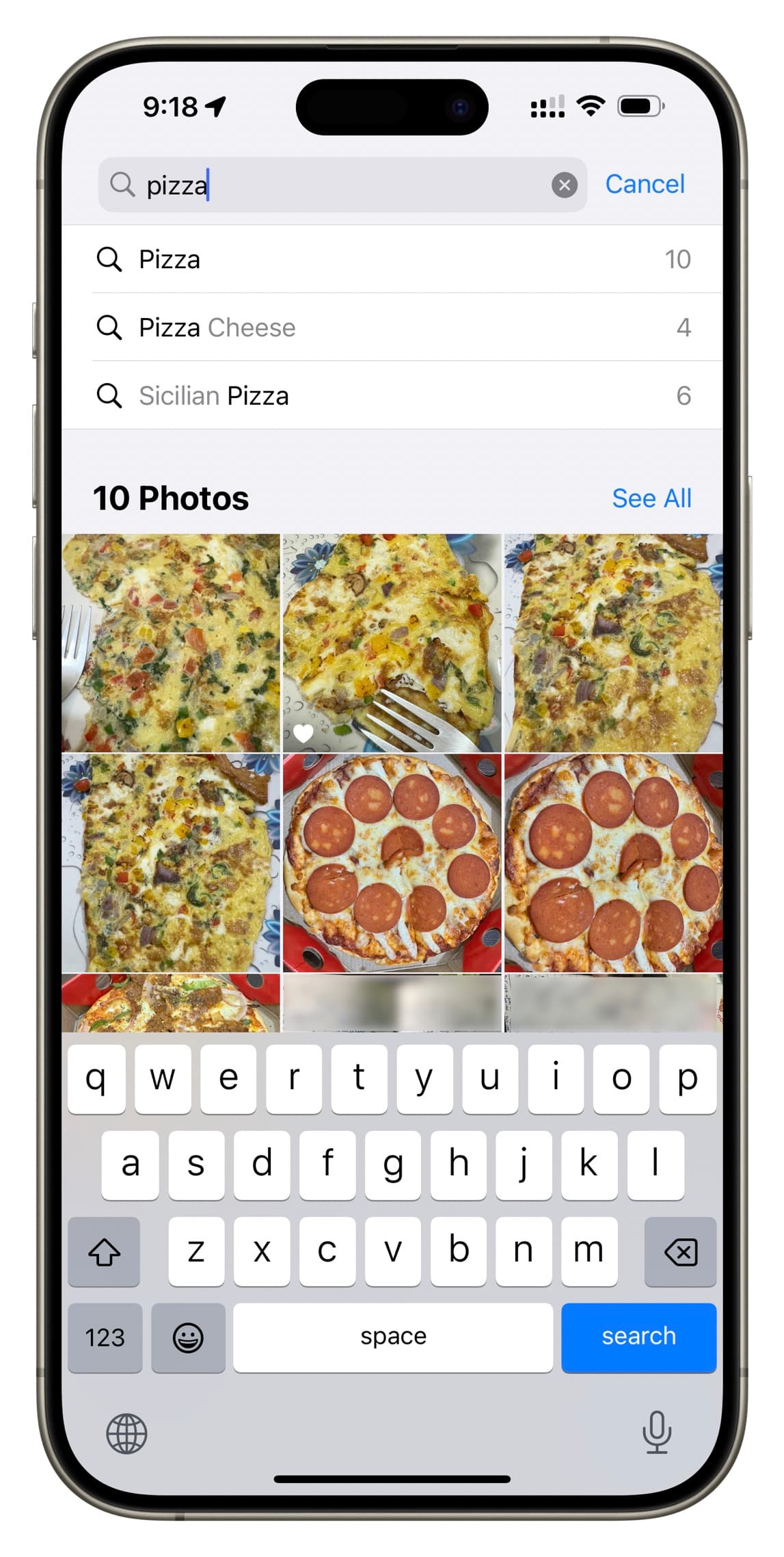

4. Bilder nach Stichworten finden

Mit der Fotos-App können Sie das richtige Bild finden, indem Sie es beschreiben. Sie können beispielsweise Folgendes eingeben:Pizza”, und es werden alle Ihre Bilder angezeigt, die Pizza enthalten.

Apple kann Ihre Fotoinhalte mithilfe fortschrittlicher Intelligenz und maschinellem Lernen analysieren, indizieren und verstehen.

Die kommende Apple Intelligence wird noch einen Schritt weiter gehen und Ihnen ermöglichen, das richtige Bild anhand langer, komplexer Begriffe zu finden, wie „Sebastien im blauen Hemd und der schwarzen Krawatte” oder “Pam mit Aufklebern im Gesicht.”

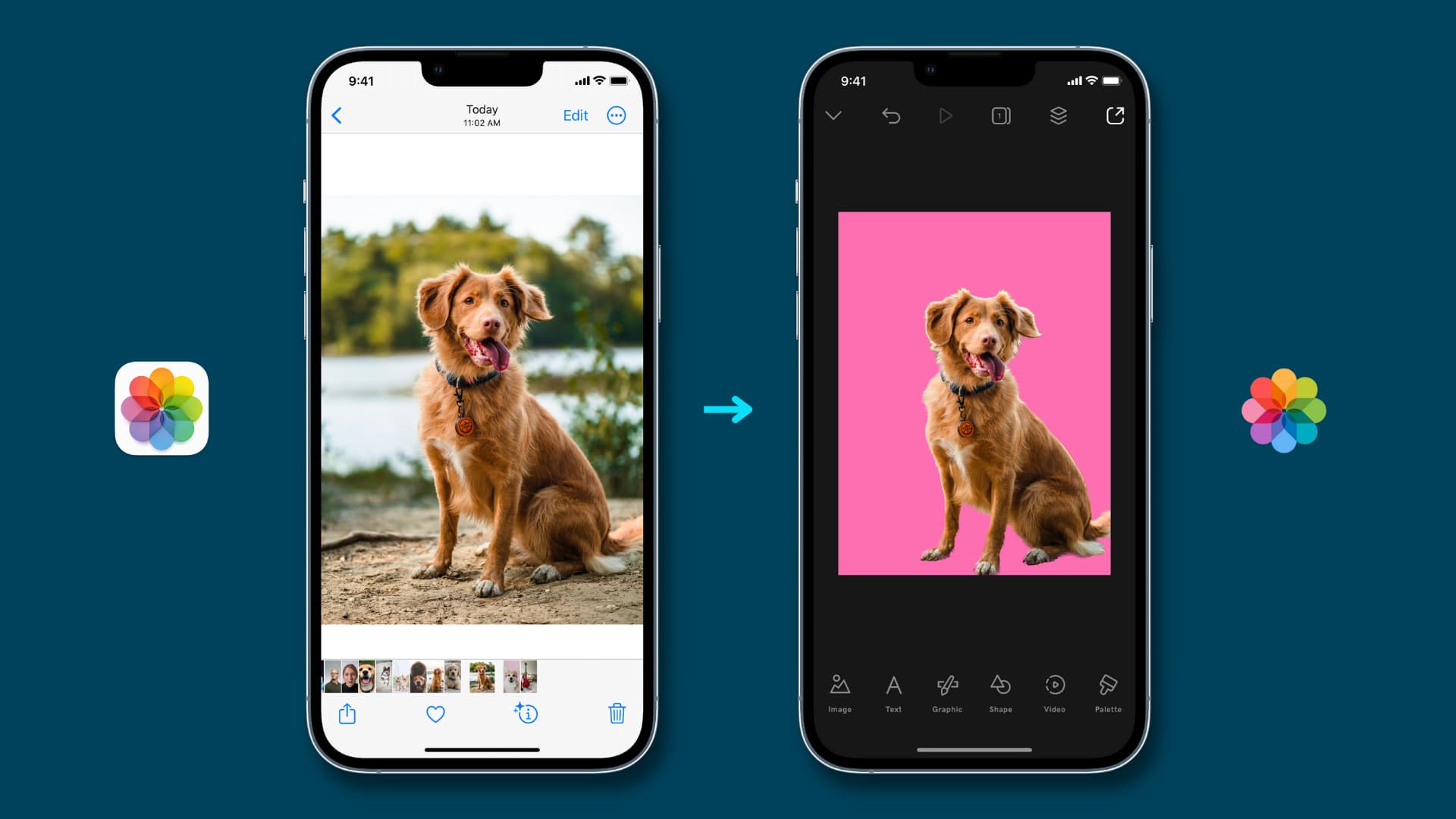

5. Das Hauptmotiv eines Bildes herausheben

Ihr iPhone und iPad können das Hauptmotiv vom Rest des Bildes unterscheiden. So können Sie Ihren Hund aus einem Foto entfernen und ihn als Sticker verwenden oder ihn in andere Apps einfügen, um beispielsweise ein Foto für Ihren Reisepassantrag zu erstellen.

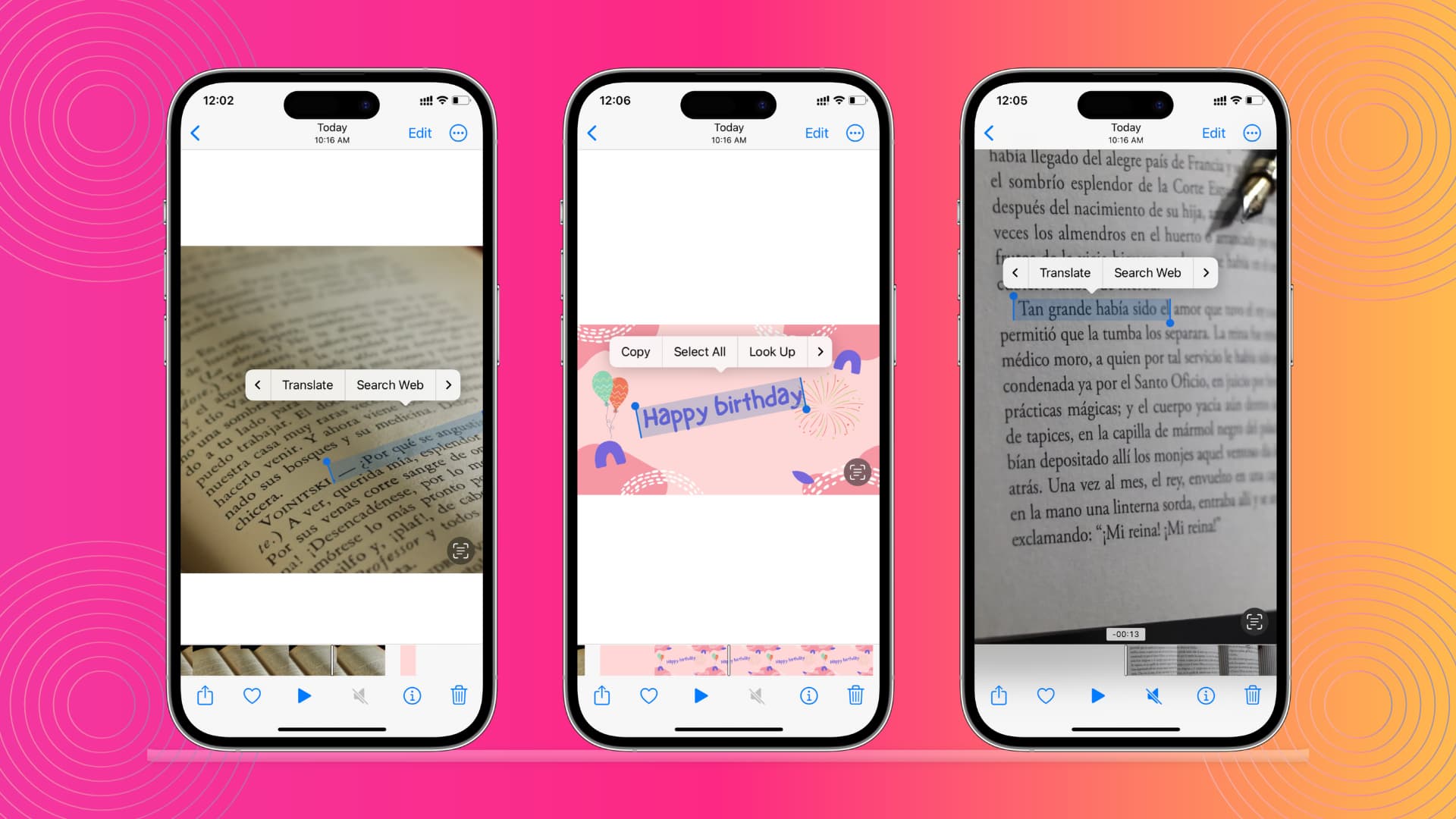

6. Text aus Bildern und Videos kopieren

Wenn Sie Text in einem Bild oder Video haben, können Sie ihn einfach berühren und in die Zwischenablage kopieren. Ihr iPhone ist intelligent genug, um Text in einem Bild zu erkennen und Sie können darauf Aktionen ausführen, als wäre es Text in einem Word-Dokument.

7. Menschen und Haustiere erkennen

Die Fotos-App kann Personen und Haustiere in Ihren Bildern erkennen und alle Bilder einer bestimmten Person an einem Ort platzieren, auf den Sie über das Menschen Abschnitt der Fotos-App.

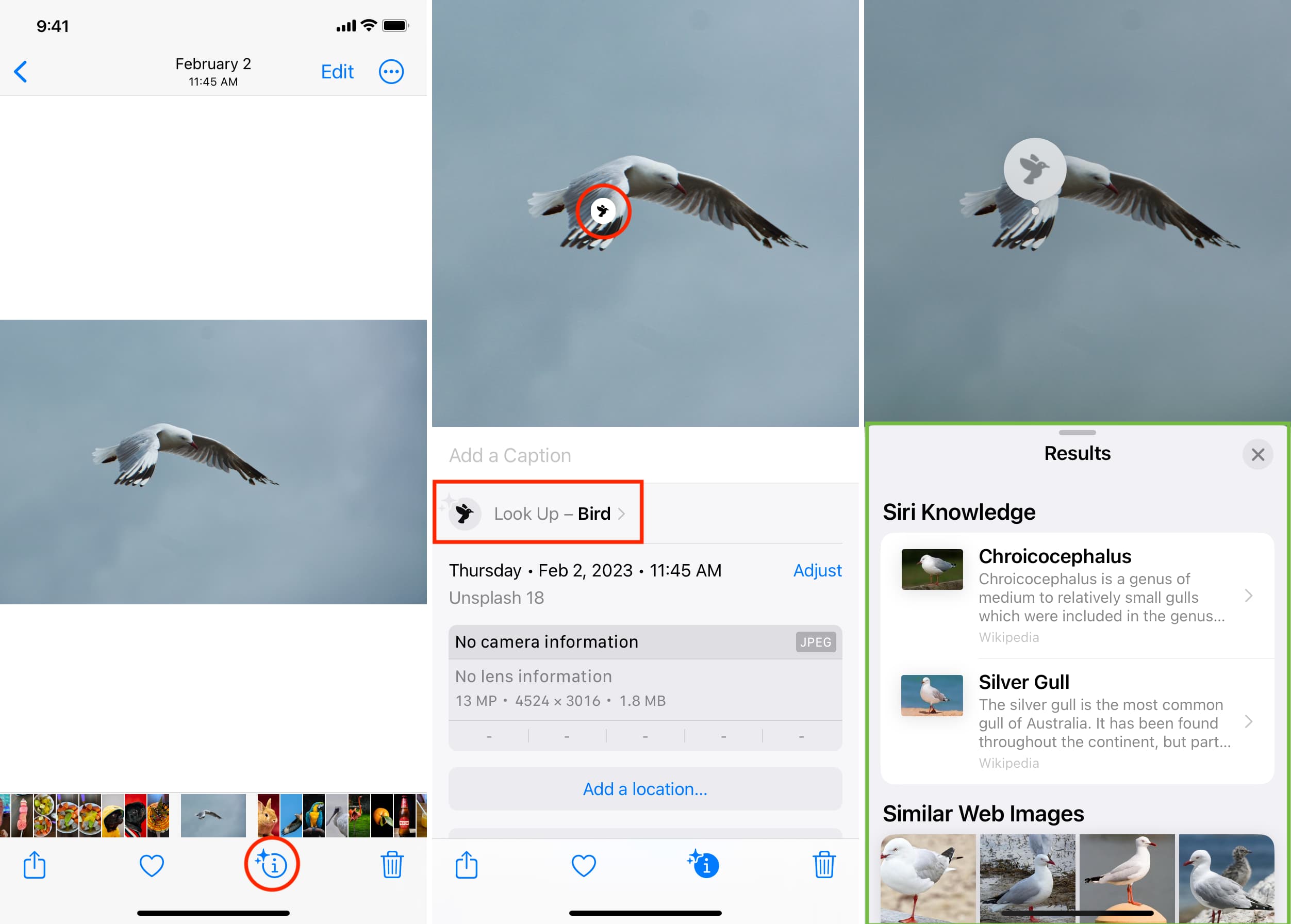

8. Erzählen Sie mehr über Essen, Blumen, Pflanzen, Kunstwerke und andere Dinge

Wenn Sie bestimmte Bilder in der Fotos-App öffnen, werden Ihnen möglicherweise spezielle Symbole angezeigt, beispielsweise die Informationsschaltfläche ⓘ mit zwei Sternen oder ein Blatt mit Sternen. Tippen Sie auf dieses Symbol oder wischen Sie nach oben, um die intelligente visuelle Nachschlageoption zu verwenden.

Diese intelligente Funktion ist praktisch, um mehr Informationen über eine Sache zu erhalten, aber denken Sie daran, dass sie häufig Fehler macht. Überprüfen Sie also immer alles doppelt.

Ihr iPhone kann sogar Waschsymbole auf Kleidungsetiketten entziffern und Ihnen weitere Informationen dazu geben!

9. Automatisches Filmen für Sie

Neben der Erkennung von Personen und Haustieren kann Ihr iPhone auch Erinnerungen und kurze Videos basierend auf einem Ereignis, einem Datum, einer Reise und anderen Parametern erstellen. Diese speziell kuratierten Medien finden Sie im Erinnerungen Und Reisen Abschnitte Ihrer Fotos-App.

10. Hilft Ihnen, bessere Bilder zu machen

Fotografische Stile, Makrofotografie, Nachtmodus, Porträtaufnahmen mit unscharfem Hintergrund und viele andere Aspekte der iPhone-Kamera-App basieren in hohem Maße auf fortschrittlichen Berechnungen und Algorithmen.

Wenn Sie beispielsweise den Auslöser drücken, kann Ihr iPhone sofort mehrere Fotos aufnehmen und dann mithilfe von Algorithmen des maschinellen Lernens die besten Aspekte aller Bilder kombinieren, sodass ein einzelnes Bild entsteht, das mit allen Details, Farben, Lichtern und der Helligkeit großartig aussieht.

11. Bietet Journaling-Vorschläge

Die Journal-App auf dem iPhone berücksichtigt Ihren Standort, die Uhrzeit, Bilder, aktuelle Aktivitäten, Musikgeschmack und andere Faktoren, um personalisierte Vorschläge zu unterbreiten. Diese können Ihnen dabei helfen, schnell einen Tagebucheintrag zu erstellen, damit Sie später an den Tag zurückdenken können. Die gesamte Verarbeitung zur Erstellung von Tagebuchvorschlägen erfolgt dank Apples fortschrittlichem maschinellen Lernen auf dem Gerät privat auf dem Gerät.

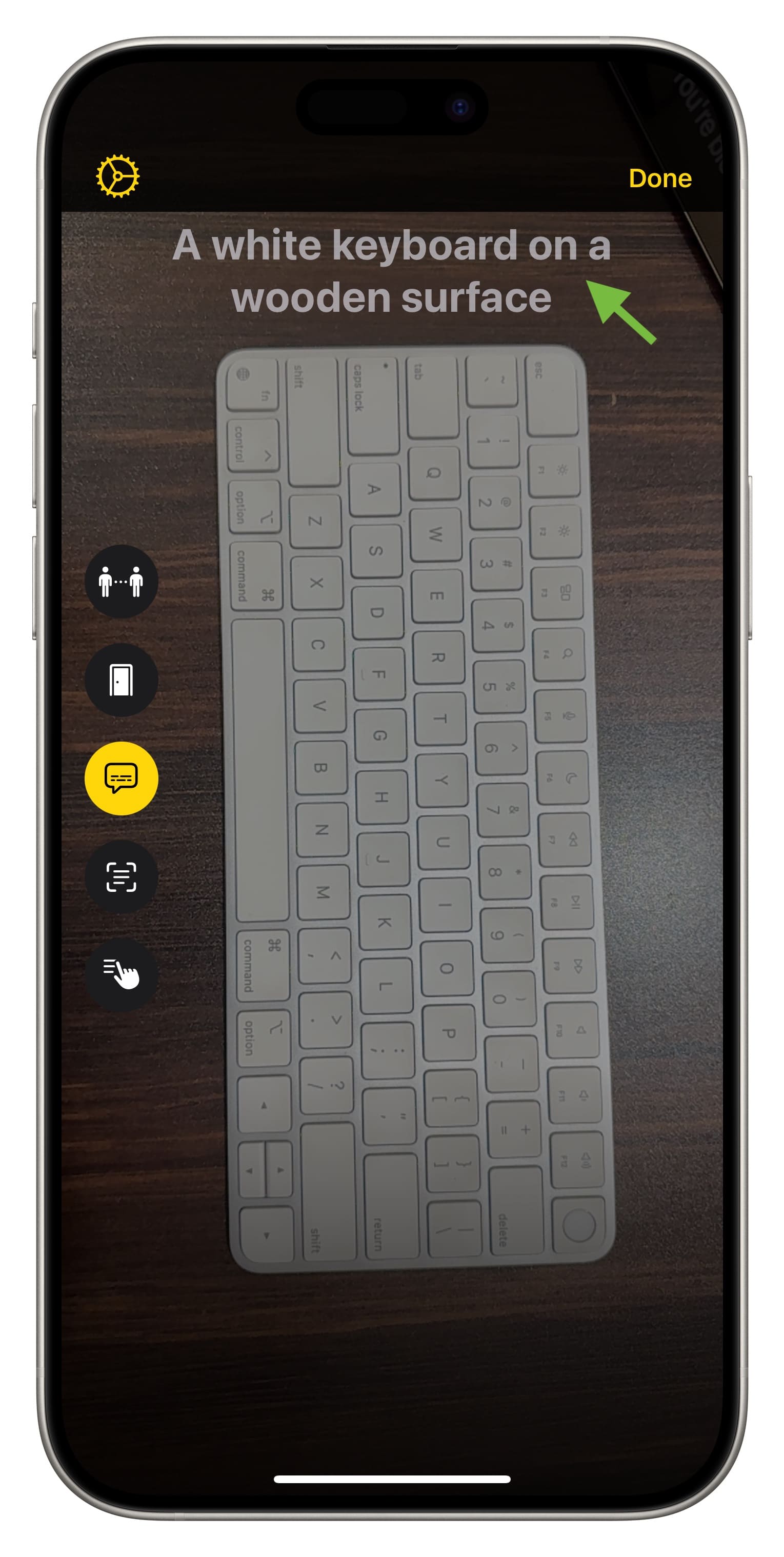

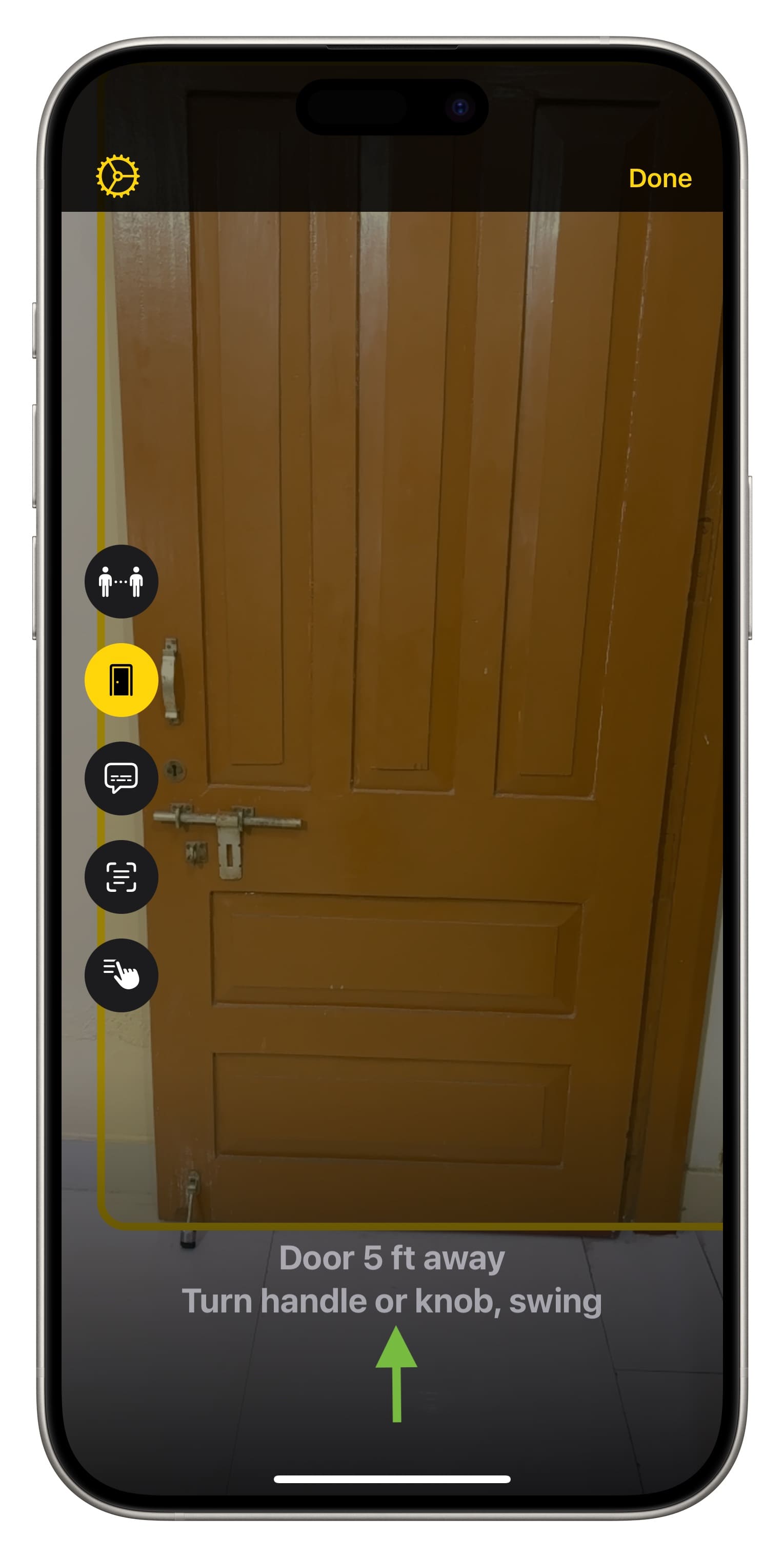

12. Echtzeit-Live-Erkennung

Dank der integrierten Intelligenz können die Live Recognition- und VoiceOver-Funktionen Ihres iPhones Personen, Türen, Text, Möbel und andere Objekte in Ihrer Umgebung erkennen und beschreiben, was sie sind. Wenn ich es beispielsweise auf meinen Schreibtisch richte, sagt es zu Recht: „eine weiße Tastatur auf einer Holzoberfläche.”

Es kann sogar erklären, wie man bestimmte Türen öffnet!

Sie können den Live-Erkennungsmodus in der Lupen-App auf Ihrem iPhone verwenden.

13. Relevante App-Vorschläge

Ob App-Mediathek, Siri-Vorschlags-Widget, Spotlight oder Sperrbildschirmvorschläge – iOS nutzt maschinelles Lernen, um Ihre Nutzungsmuster zu verstehen und an der richtigen Stelle und zur richtigen Zeit relevante Apps und Aktionen vorzuschlagen.

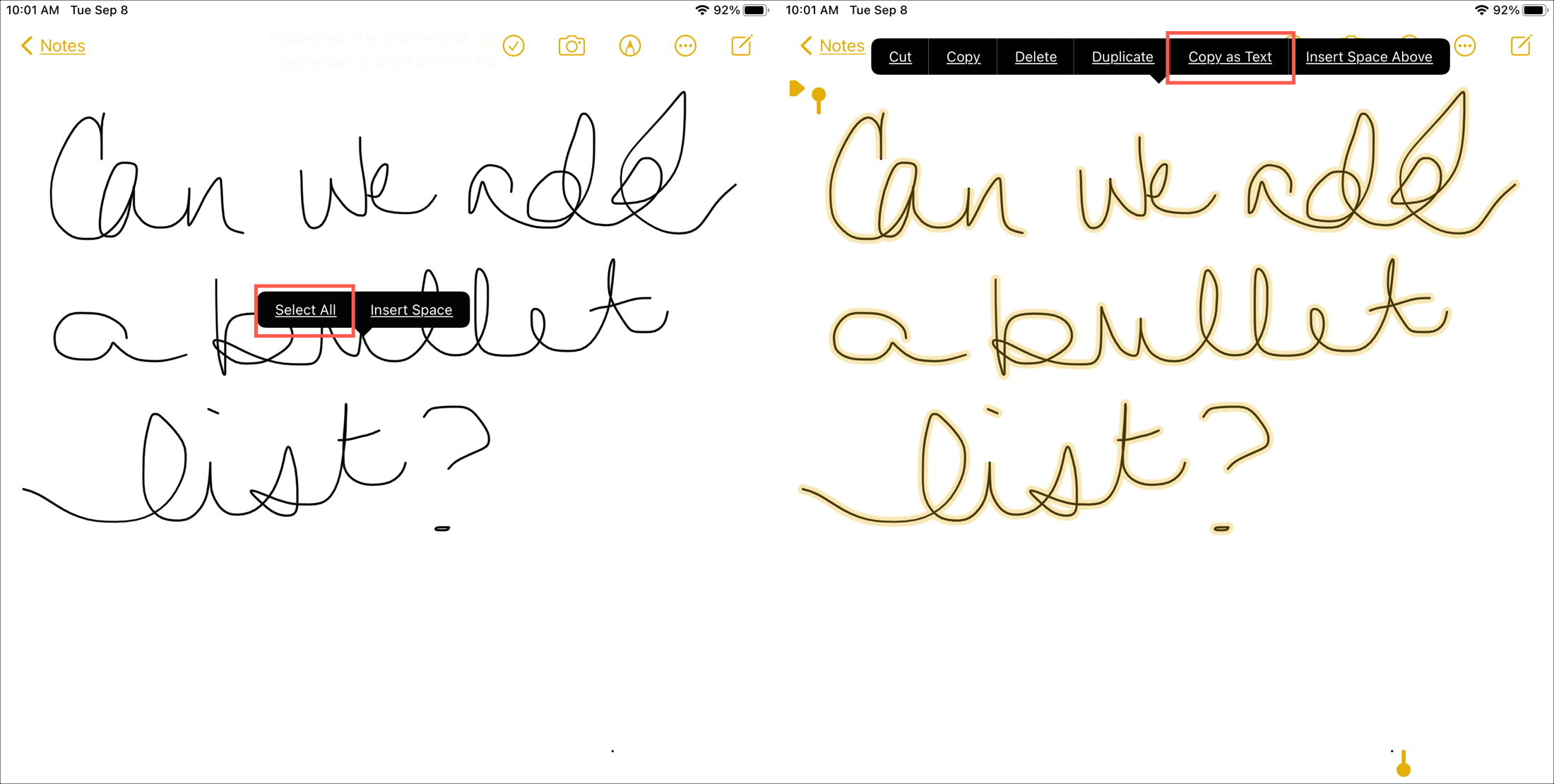

14. Handflächenerkennung bei Verwendung des Apple Pencil

Es ist offensichtlich, dass Ihre Handfläche auf dem Bildschirm ruht, wenn Sie mit dem Apple Pencil schreiben oder zeichnen. iPadOS verwendet maschinelles Lernen, um den Unterschied zwischen Ihrer Fingerberührung, der Handflächenauflage und den Stifteingaben herauszufinden. Wenn Sie also mit einem Stift zeichnen, ist die Software intelligent genug, um Ihre Handflächenberührungen zu ignorieren.

Auch beim Kritzeln mit dem Apple Pencil und beim Umwandeln von Handschrift in getippten Text bzw. beim Kopieren kommen fortschrittliche Lernalgorithmen zum Einsatz.

15. Optimieren Sie die Akkuladung und -lebensdauer

Sogar etwas so Einfaches wie das Aufladen Ihres Geräts kann mithilfe von maschinellem Lernen erledigt werden. Während Sie Ihr Gerät verwenden, versteht Ihr iPhone Ihre Lade- und Nutzungsmuster und kann Änderungen vornehmen, um seine Lebensdauer zu verlängern.

Wenn Sie Ihr iPhone beispielsweise jeden Tag vor dem Schlafengehen zum Aufladen anschließen, wird der Ladevorgang unterbrochen, wenn 80 % erreicht sind. Der Ladevorgang wird dann zur richtigen Zeit fortgesetzt, sodass Ihr Telefon beim Aufwachen 100 % geladen ist. Dadurch wird sichergestellt, dass der Akku Ihres iPhones nachts nicht stundenlang voll aufgeladen ist, und die Lebensdauer wird verlängert.

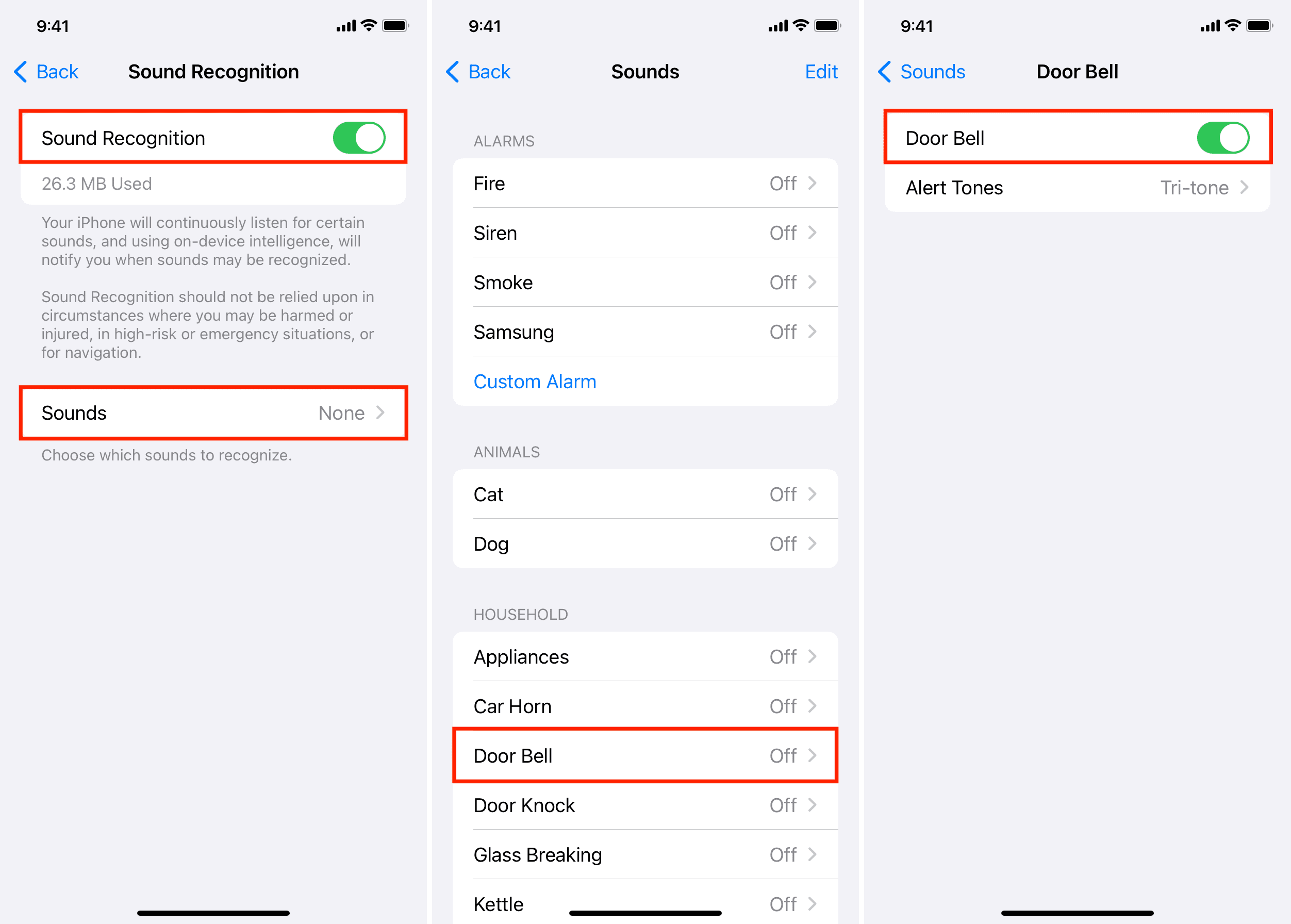

16. Tonerkennung

Ihr iPhone kann mithilfe der Geräteintelligenz verschiedene Geräusche wahrnehmen, wie etwa Feueralarm, Türklopfen, Glasbruch, Haushaltsgeräte und mehr, und Sie darüber benachrichtigen. Eine Person, die nicht hören kann, kann beispielsweise mithilfe der Geräuscherkennung feststellen, ob jemand an ihrer Tür klingelt.

17. Gesichtserkennung

Face ID verwendet bereits ein komplexes System, um Ihre Gesichtszüge zur Authentifizierung zu erkennen.

Darüber hinaus können Sie die Personenerkennungsfunktionen der Fotos-App mit HomeKit-Kameras nutzen, um Ihre Familie und Freunde zu markieren, sodass Sie wissen, wer vor der Tür steht.

Neben den oben genannten Funktionen sind auch viele andere Dinge auf maschinelles Lernen angewiesen, beispielsweise Tastaturvorhersagen, Emoji-Vorschläge, Tiefeneffekt des Hintergrundbilds auf dem Sperrbildschirm, vorgeschlagene Hintergrundbilder mit farbigem Hintergrund, Offline-Siri und mehr.

Mittlerweile denken Sie vielleicht, dass auf dem modernen iPhone fast alles mit ML und KI zu tun hat, und damit liegen Sie nicht falsch.

John Giannandrea, Senior Vice President für KI und ML bei Apple, sagte vor einigen Jahren: „Maschinelles Lernen wird in den kommenden Jahren jeden Teil des Apple-Erlebnisses verändern”, und es ist klar, dass seine Worte wahr werden.

In diesem Zusammenhang: Systemanforderungen für Apple Intelligence